Производительность на GPU: Как максимизировать эффективность вычислений

В двадцать первом веке графические процессоры (GPU) стали неотъемлемой частью вычислительных систем, не только для обработки графики, но и для выполнения вычислений общего назначения. В этой статье мы постараемсять в мир производительности на GPU, исследуя, как можно оптимизировать вычисления и какие методы улучшения действительно работают. Мы расширим наше понимание производительности на GPU, основываясь на коллективном опыте и исследованиях.

GPU обладает уникальной архитектурой, позволяющей обрабатывать множество потоков одновременно, что делает его идеальным для параллельных вычислений. Но, как показывает практика, просто наличие мощного GPU не гарантирует высокую производительность. Чтобы добиться максимальной эффективности, необходимо учитывать ряд факторов и применять правильные методы оптимизации.

Основы архитектуры GPU

Чтобы понять, как оптимизировать вычисления на GPU, важно изучить основы его архитектуры. В отличие от центрального процессора (CPU), который специализирован на выполнении последовательных задач, GPU спроектирован для одновременного выполнения множества операций. Эта параллельная структура делает GPU идеальным для задач, таких как обработка видео и машинное обучение.

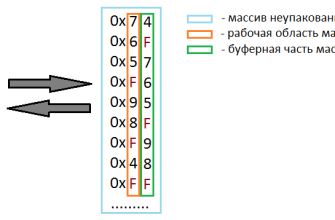

Архитектура GPU состоит из тысяч малых ядер, которые могут выполнять большое количество операций одновременно. Это позволяет GPU обрабатывать массивные объемы данных с высокой эффективностью. Основные компоненты архитектуры включают:

- Ядра: Основные единицы, выполняющие вычисления.

- Память: Важна для хранения данных и промежуточных результатов.

- Параллельные потоки: Позволяют обрабатывать множество операций одновременно.

- Технологии кэширования: Ускоряют доступ к данным.

Типы вычислений на GPU

GPU используется в различных областях, требующих высокой производительности, включая:

- Машинное обучение: Алгоритмы требуют больших вычислительных ресурсов для обработки данных и тренировки моделей.

- Обработка изображений: Фильтрация и трансформация изображений требуют параллельной обработки пикселей.

- Моделирование физических процессов: Сложные симуляции требуют огромной вычислительной мощности.

- Игровая графика: Эффективная визуализация в реальном времени требует значительных ресурсов.

Методы оптимизации производительности на GPU

Как же добиться максимальной производительности на GPU? Существует несколько методов, которые мы можем применить. Давайте рассмотрим их подробнее.

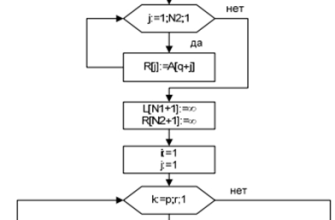

Параллельное программирование

Основной метод оптимизации — это параллельное программирование. Использование таких языков, как CUDA и OpenCL, позволяет программистам писать код, который будет использовать все ядра GPU наиболее эффективно. Важно делить задачи на мелкие подзадачи, которые могут выполняться одновременно.

Управление памятью

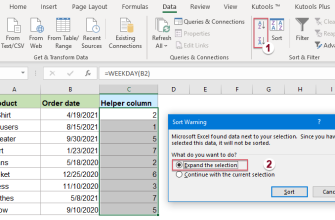

Эффективное управление памятью также играет важную роль. Инженеры должны минимизировать обращения к медленной глобальной памяти, используя более быстрые кэши. Кроме того, стоит внимательно следить за количеством записи и чтения данных из памяти.

Оптимизация алгоритмов

Выбор правильного алгоритма также существенно влияет на производительность. Использование алгоритмов, адаптированных для параллельной обработки, может дать ощутимый прирост производительности. Например, алгоритмы, основанные на разбиении задачи на независимые сегменты, лучше подходят для выполнения на GPU.

Применение производительности на GPU в реальном времени

В последние годы применение производительности на GPU вышло за пределы традиционных сценариев. Например, в области искусственного интеллекта и глубокого обучения GPU стали стандартом для ускоренной тренировки нейронных сетей. С каждым новым поколением графических процессоров мы наблюдаем дальнейший рост производительности и возможностей.

Искусственный интеллект и глубокое обучение

Разработка усовершенствованных моделей глубокого обучения требует значительного количества вычислительных ресурсов. Использование GPU позволяет значительно ускорить процесс, сокращая время тренировки с дней до часов, а иногда и минут. Такие фреймворки, как TensorFlow и PyTorch, предлагают встроенные возможности для работы с GPU, что упрощает интеграцию.

Производительность на GPU, это важный аспект современных вычислений. Максимизация эффективности требует глубокого понимания архитектуры процессора, а также применения правильных методов оптимизации. Важно помнить, что, несмотря на мощные возможности, доступные на рынке, только грамотный подход к программированию и оптимизации сможет обеспечить необходимую производительность.

Мы надеемся, что эта статья помогла вам лучше понять, как можно оптимизировать производительность на GPU и какие методы действительно работают. Если у вас есть вопросы или вы хотите поделиться своим опытом, не стесняйтесь оставлять комментарии!

Каковы основные факторы, влияющие на производительность GPU?

Основные факторы, влияющие на производительность GPU, включают архитектуру GPU, параллелизацию задач, управление памятью и выбор оптимальных алгоритмов. Понимание этих факторов позволяет разработчикам создавать более эффективные и производительные приложения.

Подробнее

| Оптимизация GPU | Производительность вычислений | CUDA разработки | Параллельные вычисления | Искусственный интеллект на GPU |

| Обработка видео на GPU | GPU в играх | Оптимизация памяти GPU | Глубокое обучение на GPU | Анализ больших данных |